2. April 2025, 12:38 Uhr | Lesezeit: 4 Minuten

Nichts belegt etwas so eindeutig wie ein Bild. Etwas glauben, weil ein Foto existiert, gilt in Zeiten von KI nicht mehr. Nachdem sich die Welt seit einigen Jahren an mit KI-generierten Texten abgefunden hat, werden sich Menschen nun an Bilder gewöhnen müssen, die ein Abbild der Realität zeigen, nur eben nicht mehr zwangsläufig die Wahrheit dokumentieren. OpenAI hat sein KI-Modell ChatGPT beigebracht, korrekte Texte in fotorealistischen Bildern einzufügen. ChatGPT-4o ist so realistisch, es erstellt sogar täuschend echte Dokumente. Warum das ein Problem ist, beleuchtet TECHBOOK in diesem Artikel.

Das „o“ im neuen GPT-Modell steht für das lateinische Wort „omni“, was übersetzt „alle“, „alles“ oder „ganz“ bedeutet. Damit möchte OpenAI deutlich machen, dass das eigene Modell nicht nur Texte, sondern nun auch fotorealistische Bilder, Quittungen und Belege samt Text erstellen kann. ChatGPT vereint somit mehrere Fähigkeiten in einem KI-Modell. „Allmächtig“ wäre daher fast schon eine präzisere Übersetzung für „omni“.

Die neue Funktion ist gerade einmal ein paar Tage online, schon kursieren unzählige KI-generierte Bilder mit Texten im Netz. Auch wenn viele dieser KI-Bilder lustig sein sollen, einige sind es definitiv nicht, sondern wirken eher beängstigend und stellen möglicherweise ein künftiges, massives Sicherheitsproblem dar. Reichte früher ein Smartphone-Foto als Beleg für eine bestimmte Situation, sollten beispielsweise Steuerbehörden dringend technisch aufrüsten.

Übersicht

Mit falschen Restaurant-Quittungen fängt es an

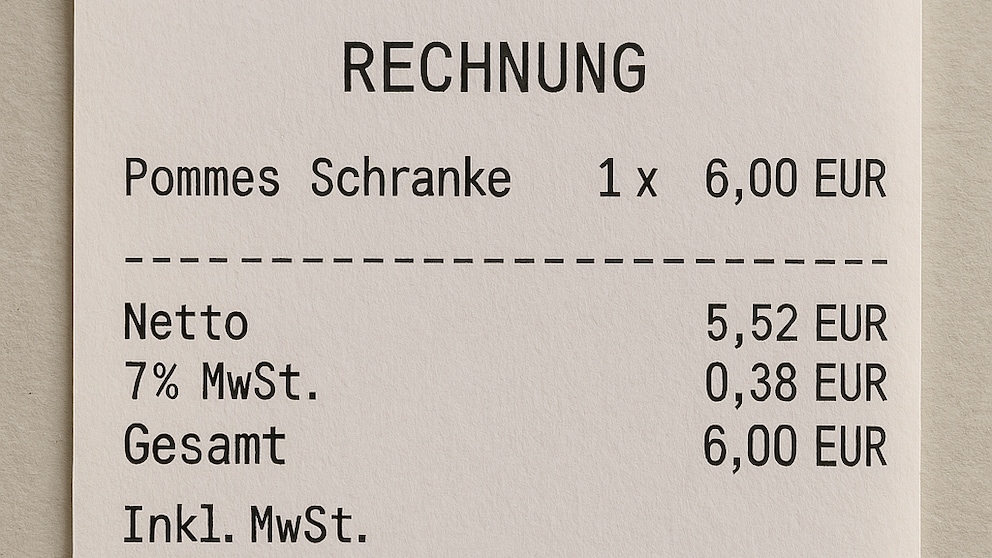

Auf X (ehemals Twitter) berichtet ein User von einer täuschend echten Restaurant-Quittung, die mit ChatGPT-4o erstellt worden ist. Der Autor dieses Artikels hat versucht, ein ähnliches KI-Bild zu erzeugen. Und siehe da in „Lars Pommesschmiede“ kostet das Gericht „Pommes Schranke“ nur sage und schreibe 6 Euro. Alles völliger Unsinn. Die KI-generierte Quittung wirkt dennoch sehr echt.

Dabei ist der Prompt für diese kleine Spielerei simpel gewesen. Name des Restaurants und der Speise sowie der Preis wurden ChatGPT-4o vorgegeben. Alles andere wie Schriftart oder Steuerausweis hat sich die KI aus den Trainingsdaten zusammengereimt. Nach weniger als drei Minuten stand das Bild zum Download bereit. Der ausgewiesene Steuerbetrag stimmt sogar, wenn die „Pommes Schranke“ zum Mitnehmen gewesen sein sollte.

Andere Autoren berichten von ähnlichen Versuchen, bei denen im Prompt nur der Name der Lokalität gereicht habe, um eine solche Fake-Quittung in Sekundenschnelle von der KI erstellen zu lassen.

Auf LinkedIn dokumentiert ein User, wie sich mittels des neuen KI-Modells von OpenAI echte Quittungen in falsche umwandeln lassen. Nochmal auf X zeigt ein anderer, wie sich beispielsweise auch Belege für abgesagte Flüge realistisch fälschen lassen.

Das sind nur wenige Netzfunde. Weitere solcher Fake-Dokumente werden in immer größerer Zahl in dieser Sekunde irgendwo verbreitet. Lässt sich ein einzelnes Bild heute möglicherweise noch als Fälschung erkennen, wird es morgen schon mit zunehmender Menge solcher KI-Fälschungen immer schwieriger. Denkt man weiter, ist die einfache Art, gefälschte Belege zu erstellen, ein nützliches Tool für Betrüger, die so beispielsweise Spam-Mails noch realistischer wirken lassen können.

OpenAI setzt auf Metadaten

Doch was sagt OpenAI zu seinem neuen GPT-4o-Modell? Das Unternehmen beschwichtigt und schreibt in einer veröffentlichten „System Card“, dass sämtliche von ChatGPT generierten Bilder automatisch über spezielle Metadaten verfügen würden, die eine Quittung, einen Beleg oder dergleichen als von einer KI erstellt ausweisen.

Klingt wunderbar, hat nur zwei Haken: Zum einen müssen Behörden oder andere offizielle Einrichtungen dann künftig Tools nutzen, die diese Metadaten prüfen und den Einsatz von KI erkennen. Wer sich ein wenig mit dem Stand der digitalen Transformation in Deutschland auskennt, der weiß, dass das Faxgerät in einigen Behörden noch immer ein relevantes Kommunikationstool ist. Zum anderen können Metadaten mit etwas IT-Kenntnissen einfach entfernt werden und Prüftools laufen ins Leere.

WWDC 2024 „Apple Intelligence“ bringt KI auf das iPhone

Alternativen 6 KI-Tools, die ChatGPT Konkurrenz machen könnten

Start in den USA Was kann das neue KI-Tool „Whisk“ von Google?

Ära der Leichtgläubigkeit ist endgültig vorbei

Gibt es andere Lösungen? Ehrlicherweise nicht. Zudem ist davon auszugehen, dass künftige KI-Modelle noch besser und schneller sind und somit noch realistischere Bilder erstellen können. Das menschliche Auge in Kombination mit gesunder Skepsis reichen bald nicht mehr aus.

Appelle an einen vernünftigen Umgang mit der KI sind moralisch ehrenhaft, verhallen in der Regel allerdings ungehört. Beispiel gefällig? Als Menschen in den frühen 2000er-Jahren Songs und ganze Musikalben kostenlos und illegal aus dem Netz gesaugt haben, gab es durchaus das Bewusstsein, hier werden Künstler gerade um ihren Lohn gebracht. Trotz entsprechender Appelle blieb die Moral am Ende jedoch auf der Strecke.

Auf lange Sicht hat sich allerdings ein komplett neues Vertriebskonzept etabliert. Somit dient das Beispiel vielleicht auch als Hoffnungsschimmer in Bezug auf Fake-Dokumente. Eine Lösung scheint es derzeit nicht zu geben. Dennoch arbeiten vermutlich schon in diesem Moment Menschen daran, eine Lösung zu entwickeln. Nur eine Gewissheit gilt ab sofort: Die Ära der Leichtgläubigkeit in Sachen Bildern und Quittungen ist mit der Einführung von ChatGPT-4o endgültig beendet.